2026年3月23日

LibreChat+OllamaでローカルLLM

LibreChatとOllamaを組み合わせて、ローカル環境で大規模言語モデル(LLM)を動作させる方法を解説します。

LibreChat

ChatGPTみたいなUIを提供するやつです。

Ollama

ローカルでLLMを動作させることのできるツールです。

以上の2つを合わせてローカルでAIを動作させていきたいっていう話。

環境

| CPU | Ryzen 7 5700X |

| RAM | 32GB |

| SSD | 1TB |

| GPU | NVIDIA RTX 4060 Ti 16GB |

| OS | ArchLinux |

今回はDockerで動かしていきます。

セットアップ

リポジトリのクローン

git clone https://github.com/danny-avila/LibreChat

cd LibreChat

.envの作成

リポジトリ内にあるexampleをコピーする。

cp .env.example .env

内容は特にいじらなくていい。

librechat.yamlの作成

これもリポジトリ内にあるexampleをコピーする。

cp librechat.example.yaml librechat.yaml

現時点では内容は編集しない。

docker-compose.override.yamlの作成

これもリポジトリ内にあるexampleをコピーする。

cp docker-compose.override.yml.example docker-compose.override.yml

これも現時点では内容を編集しない。

docker-compose.override.ymlの編集

librechat.yamlをマウントしたり、Ollamaを追加します。

services:

api:

volumes:

- type: bind

source: ./librechat.yaml

target: /app/librechat.yaml

ollama:

image: ollama/ollama:latest

container_name: ollama

restart: unless-stopped

gpus: all

ports:

- "11434:11434"

volumes:

- ./ollama:/root/.ollama

librechat.yamlの編集

Ollamaを使うように設定します。

version: 1.3.6

endpoints:

custom:

- name: "Ollama"

apiKey: "ollama"

baseURL: "http://ollama:11434/v1/"

models:

default:

- "qwen3.5"

fetch: true

titleConvo: true

titleModel: "current_model"

summarize: false

summaryModel: "current_model"

modelDisplayLabel: "Ollama"

起動

ここまで設定を進めたら起動します。

docker compose up -d

ブラウザからhttp://localhost:3080にアクセスすると、

こんな感じの画面が現れます。Sign upしてください。

ログインすると、こんな感じ。

ollamaのモデルをpull

ollamaでモデルをpullします。今回はqwen3.5を。

docker exec -it ollama ollama pull qwen3.5

モデルをpullしたら再起動します。

docker compose down && docker compose up -d

モデルの選択画面に現れればOKです。

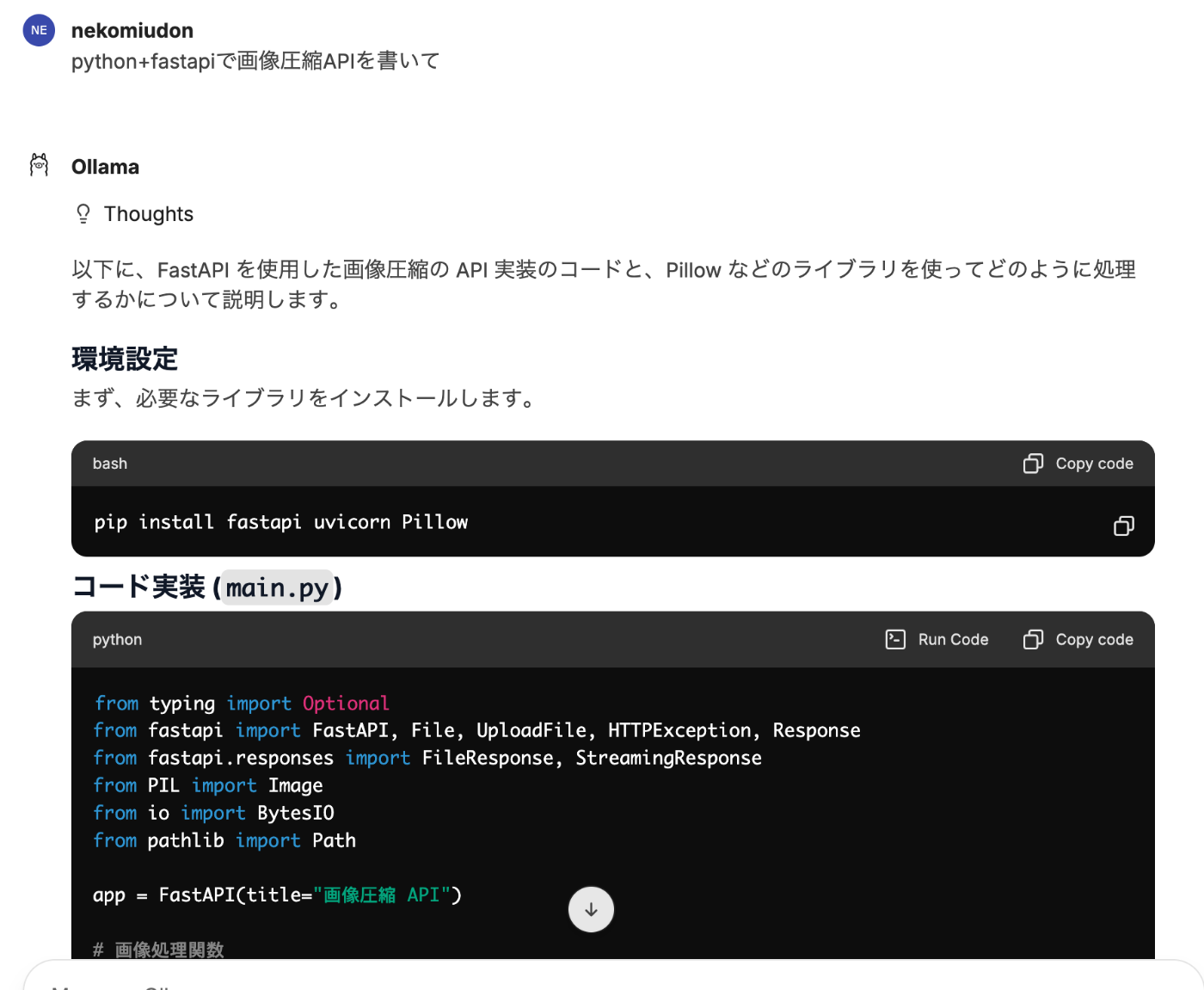

話してみる

ちゃんと話せます。

おわり

今回はここまでです。

ここでは書いていませんが検索まで設定してます。

いいぽよ。

更新履歴

2026/03/24: 一部内容に誤りがあったため修正